Validazione degli strumenti di IA per mezzo di una valutazione degli input umani

Nel mondo in costante evoluzione dell'intelligenza artificiale (AI), si sta facendo strada un nuovo approccio: la validazione Uomo-nel-Ciclo (HITL). Questo metodo combina l'efficienza dell'AI con il giudizio dell'oversight umano, assicurando che i risultati siano in linea con l'intenzione umana.

Secondo un'analisi di mercato del 2025, circa il 35% delle aziende sta pianificando di implementare la HITL per i loro sistemi AI agenti. Questo cambiamento sottolinea l'importanza crescente di determinare quando utilizzare i processi automatizzati rispetto all'oversight umano, in particolare nelle implementazioni AI ad alto rischio.

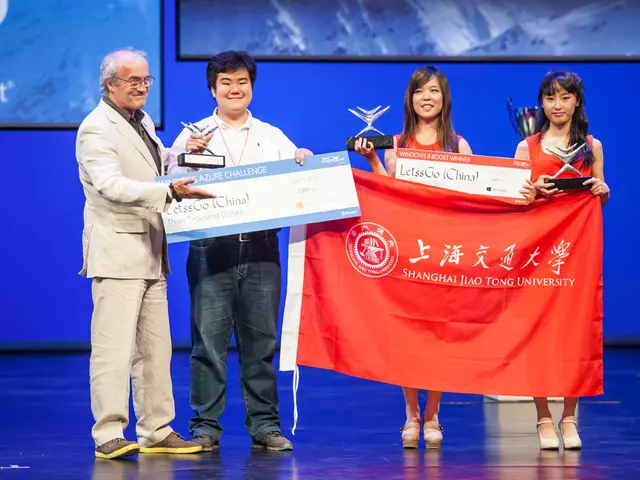

Vipin Vashisth, un appassionato di scienza dei dati e machine learning con esperienza nella costruzione di modelli, nella gestione dei dati disordinati e nella risoluzione di problemi del mondo reale, si è trovato in prima linea in questo sviluppo. Il suo ultimo progetto, ChatGPT, un agente AI progettato per i principianti nel campo dell'AI, dimostra il potenziale della HITL.

In ChatGPT, l'agente utilizza gpt-4o-mini per generare le risposte in base all'input dell'utente. Il flusso di lavoro dell'agente consiste di due nodi: il generatore AI e un nodo di revisione umano, collegati in sequenza. Il generatore AI produce una bozza, che viene quindi stampata e pubblicata immediatamente su comando dell'utente. Tuttavia, nel flusso di lavoro HITL, il processo si ferma due volte per il feedback umano.

La dimostrazione di ChatGPT ha mostrato che la revisione umana ha portato a risultati più chiari e precisi, confermando che la HITL migliora la qualità dell'output AI. Anche se la corsa automatizzata ha finito quasi istantaneamente, il flusso di lavoro HITL ha aggiunto latenza e carico di lavoro a causa dei cicli di revisione.

In Scenario 2, vengono creati due strumenti: ChatGPT e uno strumento chiamato ReviewBot. ReviewBot revisiona o modifica il contenuto dell'articolo in base al feedback dell'utente. L'idea generale è quella di utilizzare l'automazione per la sua efficienza, ma ancora avere gli esseri umani che prendono il controllo delle decisioni chiave una volta al giorno.

Le regolamentazioni e le migliori pratiche stanno sempre più richiedendo un certo livello di revisione umana nelle implementazioni AI ad alto rischio. I checkpoint umani flessibili ci aiuteranno a utilizzare l'AI agenti in modo sicuro e responsabile, assicurando che l'AI serva come rete di sicurezza per gli errori e mantenga i risultati in linea con l'intenzione umana.

Mentre continuiamo a esplorare il potenziale dell'AI, l'integrazione dell'oversight umano sarà cruciale per mantenere l'equilibrio tra automazione e responsabilità. Con l'aumento della HITL, possiamo aspettarci un futuro in cui l'AI e gli esseri umani lavorano insieme, sfruttando le rispettive forze per creare un'ecosistema AI più efficiente e responsabile.

Leggi anche:

- Due approcci alla gestione delle risorse umane: analisi comparativa delle strategie dure e compassionevoli, con indicazione dei loro vantaggi e svantaggi

- "Il principale scienziato di Toyota dichiara guerra al carbonio: liberamo tutte le nostre risorse per raggiungere la neutralità del carbonio"

- Impressioni notevoli: il top HR di Toyota è stato motivato da un approccio unico allo sviluppo degli studenti in una sola scuola

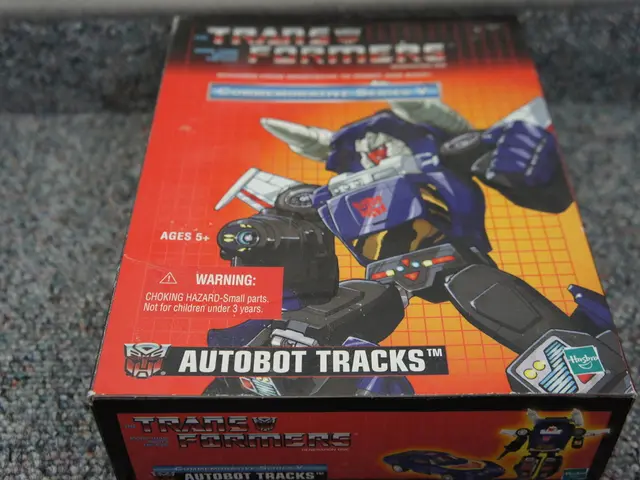

- Combinazione di potenza audio: sincronizzazione di due altoparlanti Bluetooth con il televisore