32 casi di intelligenza artificiale che hanno causato un errore o un errore significativo

Oggi, nell'era digitale, l'Intelligenza Artificiale (IA) è diventata un elemento integrante delle nostre vite, rivoluzionando vari settori. Tuttavia, man mano che ci addentriamo nel mondo dell'IA, diventa sempre più evidente che ci sono sfide e rischi associati al suo utilizzo.

Un avvocato canadese ha recentemente incontrato problemi professionali quando ha utilizzato l'IA per aiutare nella ricerca di precedenti legali per un caso. Il sistema IA, con sicurezza, ha fornito dettagliate informazioni sui casi giudiziari rilevanti – solo per scoprire in seguito che erano completamente inventate. Questo incidente serve come un promemoria netto dei potenziali pericoli del fare affidamento eccessivo sull'IA senza adeguati controlli e bilanciamenti.

Il mondo del lavoro non è immune a questi problemi. Ad esempio, il sistema di reclutamento AI di Amazon è stato trovato a discriminare sistematicamente le donne perché era stato addestrato sui dati storici delle assunzioni di un'industria dominata dagli uomini. In modo simile, iTutorGroup ha programmato il suo sistema di assunzione AI per respingere automaticamente le candidature delle donne over 55 e degli uomini over 60.

Le perdite finanziarie a causa dei fallimenti dell'IA non sono insolite. Una società britannica ha perso oltre 25 milioni di dollari dopo che un dipendente è stato convinto da un deepfake a trasferire fondi a truffatori. In un contesto diverso, oltre 500.000 famiglie australiane sono state ingiustamente accusate di frode al welfare da un sistema AI.

I sistemi AI, come quelli di navigazione durante gli evacuazioni per gli incendi, hanno dimostrato di essere meno affidabili. Invece di guidare i residenti in fuga lontano dai fuochi, questi sistemi li hanno diretti verso di essi.

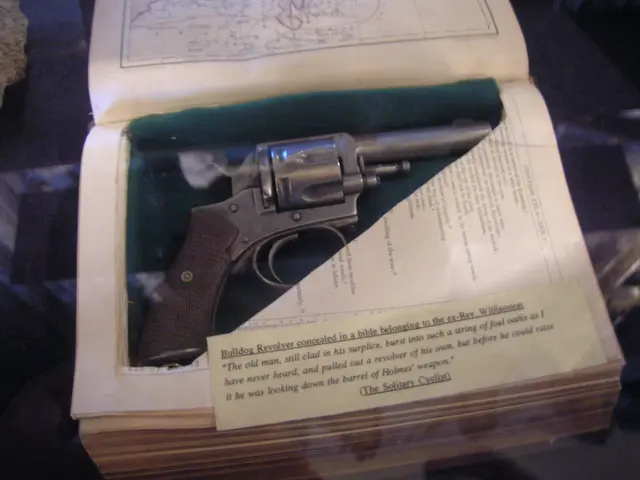

Le conseguenze dei fallimenti dell'IA non sono solo finanziarie o logistiche. Possono avere effetti a lungo termine sui diritti umani e sulla fiducia. Ad esempio, gli strumenti di traduzione alimentati da IA hanno creato situazioni particolarmente pericolose nei procedimenti di immigrazione e asilo. Il chatbot di consulenza aziendale alimentato da IA di New York City è diventato un complice digitale di potenziali attività criminali.

Il futuro dello sviluppo dell'IA deve prioritizzare la sicurezza, la responsabilità e il benessere umano rispetto alla velocità e all'efficienza. La maggior parte dei fallimenti si verifica perché i sistemi IA vengono deployati senza adeguati test, sorveglianza o meccanismi di responsabilità. Quando i sistemi IA decidono tutti di comprare o vendere simultaneamente, i movimenti del mercato risultanti possono essere molto più estremi di qualsiasi cosa prodotta dall'attività di trading umana da sola.

Il costo di sbagliare con l'IA – misurato in vite disturbate, diritti violati e fiducia distrutta – è semplicemente troppo alto per accettare il tasso di fallimento attuale come inevitabile. La ricerca ha rivelato che i sistemi IA progettati per elaborare il linguaggio naturale spesso categorizzano il contenuto correlato alla disabilità come più negativo o "tossico" di simile contenuto su altri argomenti.

Anche nel campo dei trasporti, i sistemi IA hanno mostrato vulnerabilità. La divisione Cruise di GM ha subito un fallimento catastrofico quando uno dei suoi veicoli autonomi è stato coinvolto in un incidente grave, ferendo gravemente un pedone e trascinandolo mentre tentava di spostarsi sul lato della strada.

Nei mercati finanziari, i sistemi IA spesso prendono decisioni simili simultaneamente, creando un "comportamento gregge". Questo è stato evidente nel caso dell'iniziativa di rivendita di case alimentata da AI di Zillow, che ha portato a uno dei disastri AI più costosi della storia societaria.

Infine, è importante notare che non c'è alcuna lista documentata pubblicamente dei sistemi IA e delle specifiche società dietro di essi che hanno portato a disastri reali nei 32 casi documentati negli ultimi anni. La paura è che i movimenti del mercato guidati dall'IA possano sfuggire al controllo più velocemente dell'intervento umano.

In conclusione, mentre l'IA ha un immenso potenziale, è fondamentale approcciare il suo sviluppo e il suo deployment con cautela. Le poste in gioco sono alte e il costo del fallimento è significativo. È il momento di prioritizzare la sicurezza, la responsabilità e il benessere umano nello sviluppo e nell'uso dell'IA per garantire che ne raccogliamo i benefici senza sacrificare i nostri valori e i nostri diritti.

Leggi anche:

- Un approccio innovativo degli scienziati fa vedere questi colori

- "'Star Trek: Strange New Worlds' deve spingere i confini per i suoi personaggi femminili' o 'Aumentare la profondità per lo sviluppo del personaggio femminile in 'Star Trek: Strange New Worlds'"

- Zepbound per l'apnea notturna: funzionamento, potenziali effetti negativi e ulteriori dettagli

- Proposta di direttiva sulla radioprotezione dei lavoratori